CPT: Efficient Deep Neural Network Training via Cyclic Precision

预备知识

- Cosine learning rate schedule 是一种常用的技巧被用在深度学习之中.

核心思想

很以往的 low-precision 方法不同, 本文试图证明, 通过渐进式地增加训练精度, 可以增强模型的泛化能力 (低精度训练所造成的 noise 反而有利于增强泛化性), 因此提出了 Cyclic Precision Training (CPT).

CPT 模仿 Cosine learing rate, 其约束训练精度为:

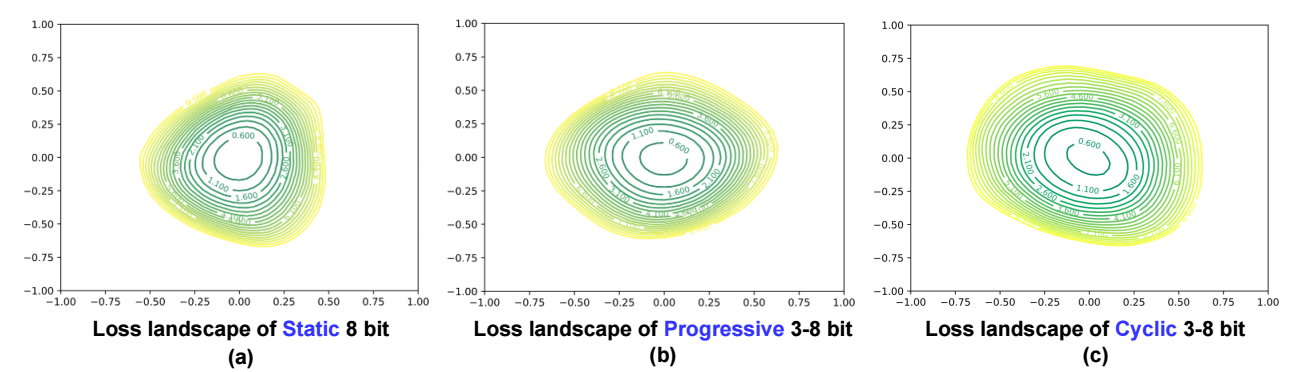

$$ B_t^n = \lceil B_{min}^n + \frac{1}{2} (B_{max}^n - B_{min}^n) (1 - \cos ( \frac{t\% T_n}{T_n} \pi )) \rfloor. $$下图验证了通过 CPT 训练可以使得模型收敛到一个更宽阔的 loss landscape, 因而具有更好的泛化性.